- 1

Joined: 01/09/2017

Liệu chip AI chuyên dụng có phá vỡ quyền lực của Nvidia như ASIC với crypto?

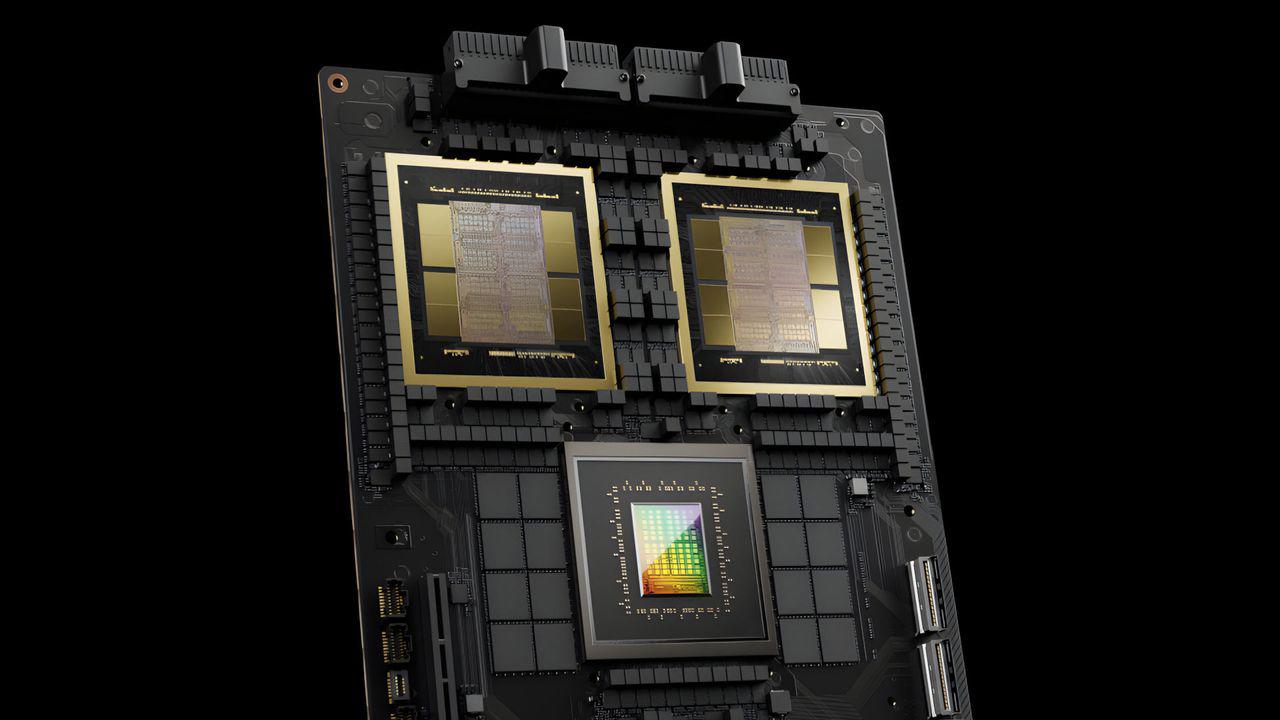

Thị trường xử lý AI đang bùng nổ nhanh hơn nhiều phân khúc phần cứng trước đây, và trong trung tâm của cơn sốt đó là Nvidia — nhà cung cấp GPU được dùng rộng rãi cho huấn luyện và suy luận mô hình lớn. Tuy nhiên, câu hỏi được nhiều chuyên gia và nhà đầu tư đặt ra là liệu thế hệ chip chuyên dụng cho AI (AI accelerators) có thể làm với GPU những gì ASIC đã làm với đào tiền mã hóa: đẩy nhanh hiệu năng và hiệu suất năng lượng đến mức khiến GPU kém cạnh tranh trong những tác vụ nhất định?

Những gì phần cứng chuyên dụng mang lại

Những gì phần cứng chuyên dụng mang lại

Chip chuyên dụng cho AI không phải là ý tưởng mới: Google TPU, AWS Inferentia và Trainium, Cerebras, Graphcore, cùng các giải pháp của Intel (Habana) hay các startup như SambaNova đã chứng minh lợi thế khi tối ưu kiến trúc cho các phép toán tensor, băng thông bộ nhớ và hiệu năng năng lượng. So sánh trực tiếp, các thiết kế này thường mang lại hiệu năng trên watt tốt hơn GPU đa năng vì chúng hy sinh tính linh hoạt để đổi lấy đường ống dữ liệu và đơn vị tính toán được tối ưu cho mạng neural.

Trong lịch sử, ASIC đã làm thay đổi thị trường crypto bằng cách cung cấp hiệu suất/chi phí vượt trội cho một tác vụ rất cụ thể: băm thuật toán. Kết quả là GPU, vốn trước đó được sử dụng rộng rãi cho khai thác, bị đẩy khỏi thị trường đó. Điều tương tự có thể xảy ra với GPU trong những ngóc ngách AI nếu chip chuyên dụng chiếm ưu thế về chi phí hoạt động cho tác vụ huấn luyện hoặc suy luận quy mô lớn.

Rào cản lớn: phần mềm, hệ sinh thái và tính linh hoạtTuy nhiên, có rào cản quan trọng khiến một “nội chiến” kiểu ASIC khó diễn ra nhanh: hệ sinh thái phần mềm. Nvidia không chỉ bán silicon; họ cung cấp CUDA, cuDNN, các bộ công cụ tối ưu và một cộng đồng to lớn các nhà phát triển, cùng khả năng mở rộng qua hệ thống DGX và hạ tầng phần cứng/tích hợp mạng tốc độ cao. Việc chuyển mô hình, tối ưu hóa và duy trì cho một kiến trúc mới tiêu tốn nhân lực và thời gian — chi phí mà nhiều công ty không sẵn sàng chấp nhận ngay lập tức.

Thêm vào đó, nhiều workload trong AI đòi hỏi tính linh hoạt: nhanh chóng thử nghiệm mô hình mới, thay đổi kích thước batch, hay thực hiện các bước tiền xử lý/phục hồi phức tạp — nơi GPU đa năng vẫn có lợi thế.

Những kịch bản có thể dẫn đến chuyển dịch- Nếu các chip chuyên dụng tiếp tục cải thiện tương đối về hiệu suất/chi phí mỗi phép toán và mở rộng hỗ trợ phần mềm, các trung tâm dữ liệu lớn có thể chuyển dần một phần workload sang chúng.

- Trong suy luận tại biên (edge) và các ứng dụng cần hiệu suất năng lượng cao, chip chuyên dụng có khả năng chiếm thị phần nhanh hơn.

- Những tiêu chuẩn mở và công cụ chuyển đổi model (ví dụ ONNX) có thể giảm ma sát đổi nền tảng, làm gia tăng áp lực cạnh tranh cho Nvidia.

Khả năng một thế hệ chip AI chuyên dụng "vỡ bong bóng" Nvidia như ASIC với crypto không phải là điều bất khả thi, nhưng cũng không phải kịch bản gần trong ngắn hạn. Nvidia đang có lợi thế lớn về phần mềm, hệ sinh thái và quy mô sản xuất. Ngược lại, chip chuyên dụng có lợi thế rõ ràng về hiệu suất năng lượng cho những tác vụ chuyên biệt và đang được đầu tư mạnh. Kết quả nhiều khả năng là một thị trường phân mảnh, nơi GPU vẫn chiếm ưu thế ở nhiều workload linh hoạt và phát triển nhanh, trong khi các accelerator chuyên dụng phục vụ tốt hơn cho dịch vụ suy luận quy mô lớn, edge AI hoặc những trung tâm dữ liệu tìm cách tối ưu chi phí vận hành.

Để đọc thêm phân tích, tham khảo bài gốc của PC Gamer: PC Gamer, cùng các nguồn công nghệ chuyên sâu như AnandTech và tài liệu sản phẩm từ nhà cung cấp chip như Google TPU hay AWS ML để có cái nhìn đa chiều hơn.

- 1